- Pesquisadores do MIT mostraram, por meio de um modelo computacional, como o cérebro consegue focar em uma única voz entre várias em ambientes barulhentos, conhecido como “cocktail party problem” (problema da festa de cocktail).

- O estudo sugere que ampliar a atividade de unidades neurais que respondem a características da voz-alvo, como o tom, faz com que essa voz ganhe destaque no processamento auditivo.

- O modelo é treinado com uma instrução (cue) sonora da voz desejada; a ativação das unidades determina ganhos multiplicativos que realçam a voz-alvo quando o estímulo seguinte é ouvido.

- Além do tom, o experimento mostrou que a posição espacial da voz ajuda a selecionar o alvo; o modelo apresenta melhor desempenho quando alvo e ruído estão em locais diferentes no plano horizontal.

- Pesquisadores anunciam aplicações potenciais, incluindo simular audição com Implante coclear, com o objetivo de melhorar o foco em ambientes barulhentos; o estudo foi financiado pelo National Institutes of Health (Institutos Nacionais de Saúde).

MIT elucida como o cérebro foca numa voz em meio a várias

Pesquisadores de neurociência da MIT desenvolveram um modelo computacional que demonstra como o cérebro amplia a voz-alvo e reduz ruídos para resolver o “cocktail party problem”. O estudo mostra que aumentar a atividade de unidades que respondem a traços da voz desejada pode levar o foco atencional.

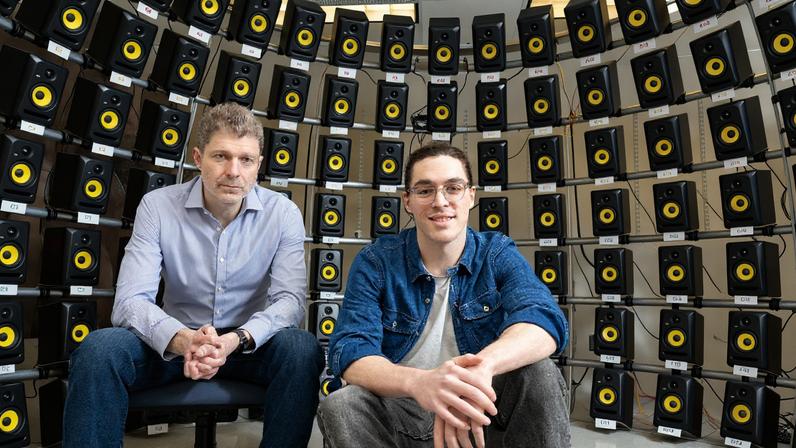

O trabalho, liderado pelo professor Josh McDermott, usa uma rede neural adaptada com ganhos multiplicativos em estágios de processamento. A pesquisa foi publicada hoje na Nature Human Behavior, com Ian Griffith como autor principal e R. Preston Hess entre os coautores.

Como o modelo funciona

O modelo recebe um “cue” auditivo com a voz a ser observada e ajusta ganhos multiplicativos conforme as características desejadas, como tono. Em seguida, é apresentado a uma mistura de vozes, e o modelo identifica a segunda palavra da voz-alvo com resultados semelhantes aos humanos.

Griffith destaca que as unidades associadas aos traços da voz-alvo ganham força, enquanto outras reduzem a atividade. A abordagem testa se esse ganho é suficiente para replicar a atenção humana ao som.

Resultados e impactos

Experimentos mostram que, sob várias condições, o modelo reproduz padrões de comportamento observados em pessoas, incluindo erros típicos em vozes com tons parecidos. A semelhança entre respostas humanas e do modelo sustenta a hipótese do ganho multiplicativo.

Além do tom, a localização espacial também ajuda. O modelo aprendeu a usar posição da voz-alvo para selecionar o som correto, especialmente quando alvo e distração estão em locais diferentes no plano horizontal.

Aplicações e próximos passos

Os pesquisadores testaram cenários com diferenças verticais de localização, encontrando maior dificuldade de separação. Estudos com humanos confirmaram esse efeito observado no modelo.

A equipe planeja aplicar a modelagem para simular audição com implantes cocleares, buscando melhorar a atenção em ambientes ruidosos. O estudo recebe financimento do National Institutes of Health.

Entre na conversa da comunidade