- Pesquisadores do MIT e parceiros desenvolveram um método para usar o tempo ocioso de processadores na etapa de treinamento de modelos de raciocínio (LLMs), aumentando a velocidade sem perder precisão.

- O sistema treina de forma adaptativa um modelo menor, chamado drafter, para prever as saídas do modelo maior, que as verifica, reduzindo o trabalho do modelo principal.

- A solução, batizada de Taming the Long Tail (TLT), tem dois componentes: um treinador de drafter adaptativo e um motor de rollout adaptativo, que ajusta a estratégia de decodificação conforme a carga de treino.

- Em testes com diferentes LLMs de raciocínio, a velocidade de treinamento aumentou entre setenta e duzentos por cento, mantendo a acurácia.

- O trabalho envolve NVIDIA, ETH Zurich, MIT-IBM Watson AI Lab e a Universidade de Massachusetts, Amherst, e será apresentado na ACM International Conference on Architectural Support for Programming Languages and Operating Systems.

A pesquisa propõe acelerar o treinamento de modelos de linguagem de grande escala (LLMs) ao usar o tempo ocioso de computadores. O método, desenvolvido por pesquisadores do MIT e parceiros, permite dobrar a velocidade de treinamento sem perder precisão. A técnica envolve treinar um modelo menor para prever as saídas do modelo maior, que verifica as respostas.

O sistema, chamado Taming the Long Tail (TLT), usa dois componentes adaptáveis. Primeiro, um drafter treinável durante ociosidade de processadores. Segundo, um motor de rollout adaptativo que ajusta a estratégia de decodificação conforme a carga de treino. O objetivo é transformar tempo ocioso em ganho de velocidade.

Em RL, o treinamento de LLMs envolve gerar várias respostas e selecionar a melhor, repetindo o processo milhares de vezes. O custo é elevado porque a fase de rollout pode consumir até 85% do tempo de treino. O drafter rápido reduz esse custo ao prever saídas para verificação.

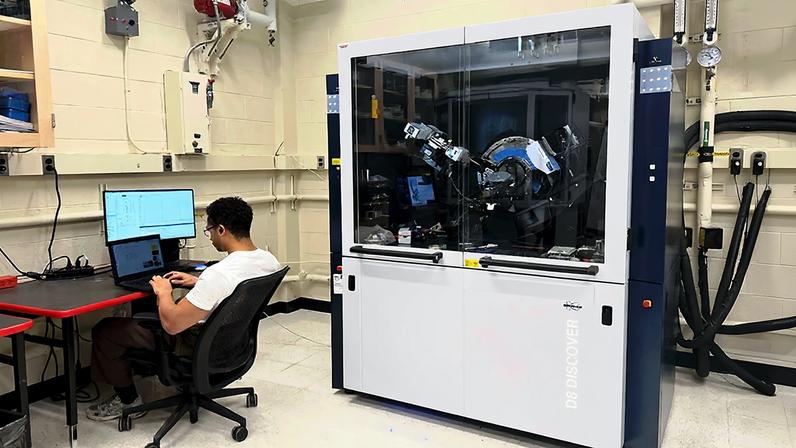

O estudo demonstra que o TLT acelera o treinamento entre 70% e 210%, mantendo a acurácia. Os resultados foram testados em diferentes LLMs de raciocínio, com dados do mundo real. O drafter menor também pode servir à implantação eficiente.

A equipe destaca que o drafter é treinado de forma contínua, alinhando-se ao modelo-alvo sem aumentar custo. Dados de verificação são usados para orientar a seleção de estratégias de decodificação para cada lote de entradas.

A pesquisa contou com apoio do MIT-IBM Watson AI Lab, MIT AI Hardware Program, MIT Amazon Science Hub, Hyundai Motor Company e NSF. Os autores envolvidos incluem Qinghao Hu, Shang Yang e outros pesquisadores do MIT, NVIDIA, ETH Zurich e UMass Amherst. A apresentação ocorrerá em conferência da ACM.

Entre na conversa da comunidade