- A Anthropic retomou as conversas com o governo dos Estados Unidos sobre o uso militar de suas ferramentas de IA, incluindo o Claude.

- A empresa não quer que os modelos sejam usados para vigilância em massa nem para armas autônomas; o governo americano indica interesse em usar para qualquer finalidade lícita.

- Anteriormente, o presidente dos EUA determinou que agências federais deixassem de usar os programas da Anthropic, e o secretário de Guerra ameaçou classificar a empresa como risco para a cadeia de fornecimento.

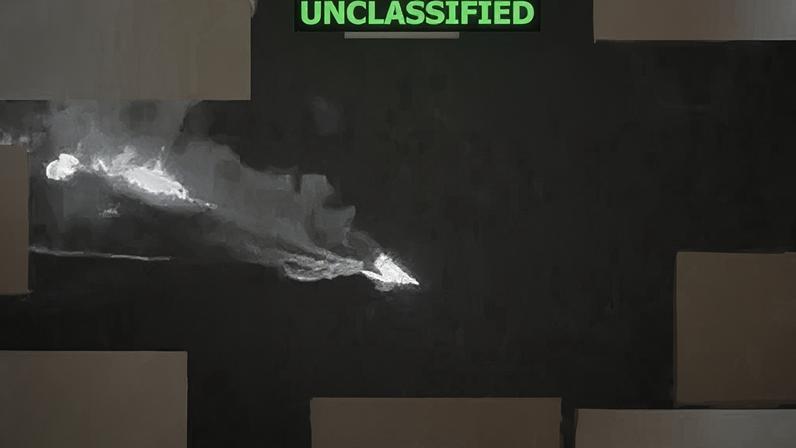

- Mesmo com a ordem, o Claude foi utilizado pela ofensiva militar contra o Irã, segundo reporta o The Wall Street Journal, o que aumenta a pressão por acordo entre as partes.

- A OpenAI pode ter planos impactados pela disputa; a Anthropic já assinou contrato com a defesa dos EUA em 2025 para uso militar de IA, no valor de US$ 200 milhões.

A Anthropic anunciou a retomada das negociações com o governo dos Estados Unidos sobre o uso militar de seus modelos de IA, incluindo o Claude. A informação foi publicada pelo Financial Times nesta quinta-feira (5).

O tema voltou a ganhar atenção após um impasse recente sobre como as IA da empresa poderiam ser empregadas pelas Forças Armadas dos EUA. A Anthropic tem se colocado contrária a usos como vigilância em massa e sistemas de armamento autônomos.

A disputa ocorreu em meio a tensões entre a empresa e autoridades do governo americano, que já haviam discutido a aplicação de IA em fins militares. Não houve acordo público até o momento, e o assunto segue em pauta.

Retomada das negociações

Segundo o Financial Times, a conversa sobre regras de uso de Claude voltou a ganhar impulso após o governo sinalizar interesse em possibilidades de aplicação lícitas. A Anthropic mantém posição de evitar usos que violem direitos civis e normas de distanciamento ético.

O cenário é relevante porque o acordo pode permitir que militares revisem avaliações de inteligência, identificação de alvos e simulações de cenários, utilizando as IA da empresa dentro de parâmetros acordados. A discussão envolve questões de cadeia de fornecimento e segurança nacional.

Contexto e impactos

O tema ganha importância porque envolve contratos já firmados com o setor de defesa. Em 2025, a Anthropic assinou um acordo de US$ 200 milhões com o Departamento de Defesa dos EUA, tornando-se a primeira empresa de IA a firmar tal contrato. A OpenAI também negocia uso de IA pelo Pentágono.

O governo americano já atuou anteriormente para restringir usos de IA de algumas empresas, mas, segundo relatos, equipes da Defesa buscam clareza sobre a aplicação de Claude em operações militares. A repercussão envolve empresas concorrentes do setor, com impactos potenciais em parcerias com o Pentágono.

Entre na conversa da comunidade